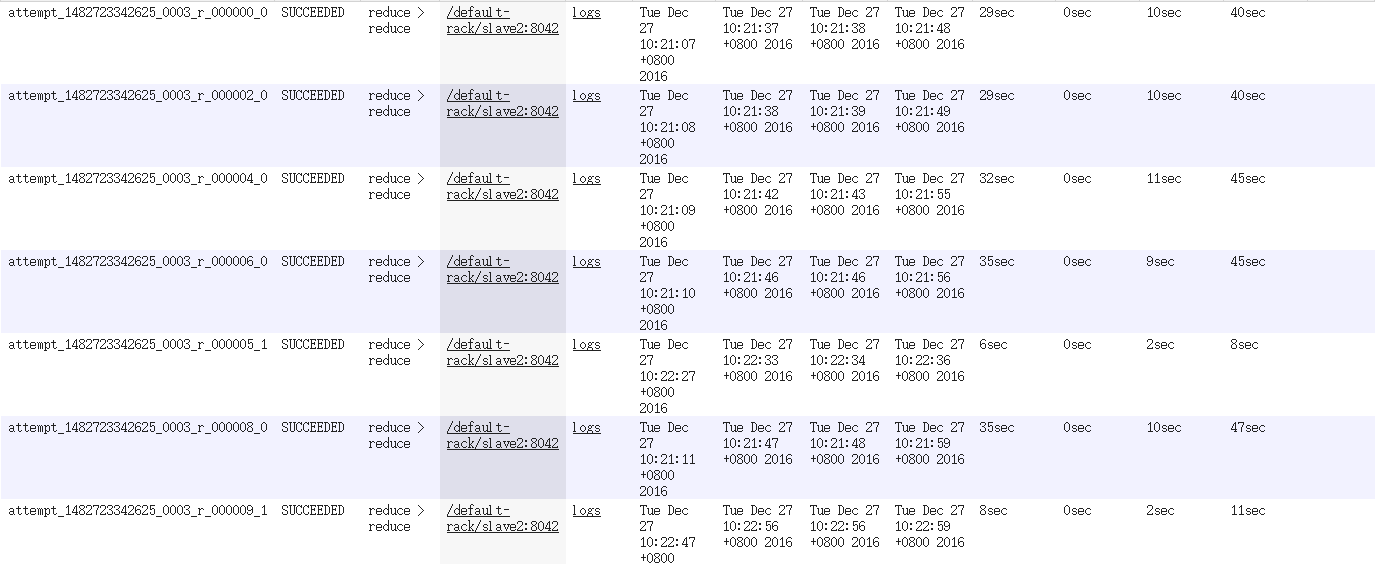

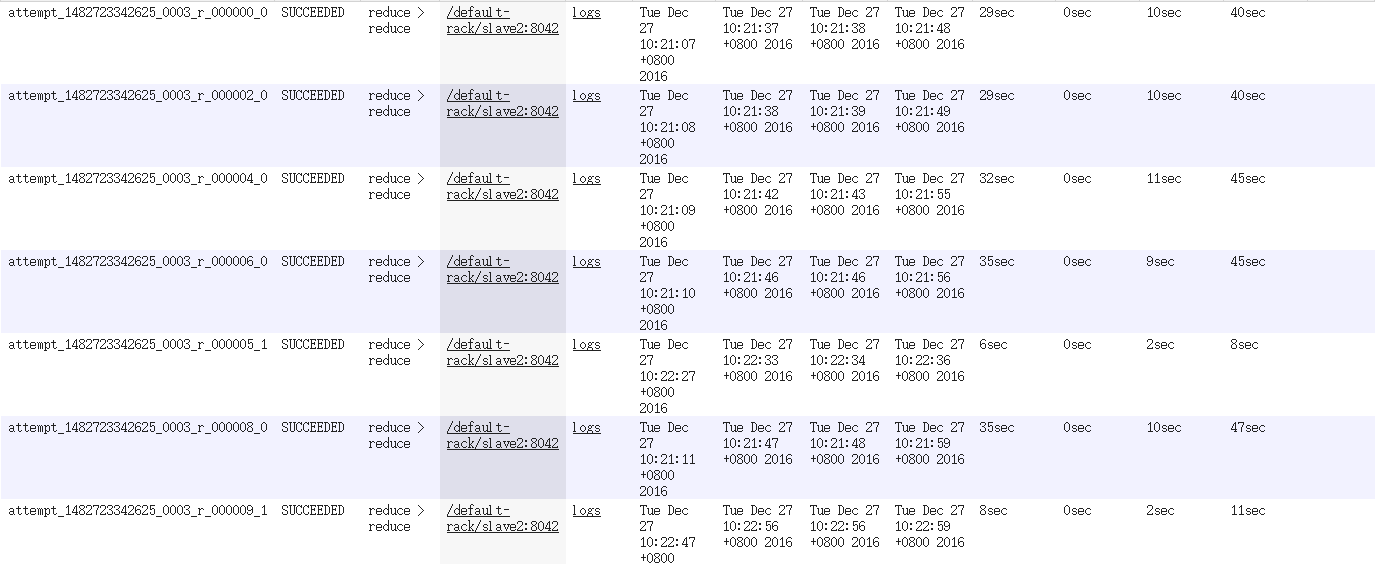

请教个问题:我的hadoop集群有两个datanode,每个datanode配置为500cpu,512内存。关于yarn中的containner配置我都使用的是默认值,那是不是一个datanode在同一时间只能有一个container运行任务?我如果设置10个reduce任务,那需要10个container,在一个datanode节点上第一个reducer运行完然后再运行第二个、第三个。。。。,是这样吗?感觉实际情况和我理解的有偏差哦,截图如下:

运行结果显示,我同时运行了多个reduce任务,那就需要多个container,可是问题是我没有这么多提供containner的资源啊?这是为什么?

发帖

发帖 与我相关

与我相关 我的任务

我的任务 分享

分享