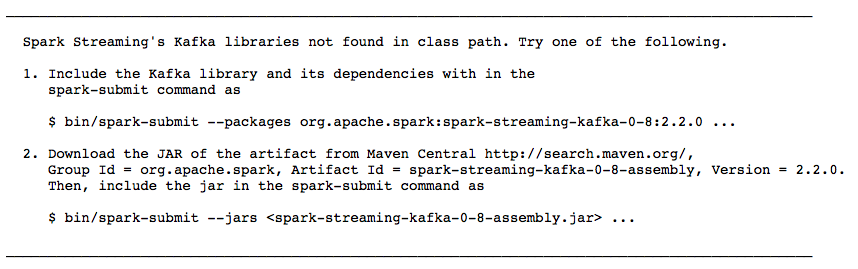

我提交的kafka streaming任务,提交的脚本是:submit --jars spark-streaming-kafka-0-8-assembly_2.11-2.0.2.jar --master mesos://HOST:7077 --deploy-mode cluster --executor-memory 2G --total-executor-cores 50 --conf spark.default.parallelism=600 --conf spark.streaming.kafka.maxRatePerPartition=30 http://HOST:PORT/main.py,然后运行的时候会报jar包缺失:

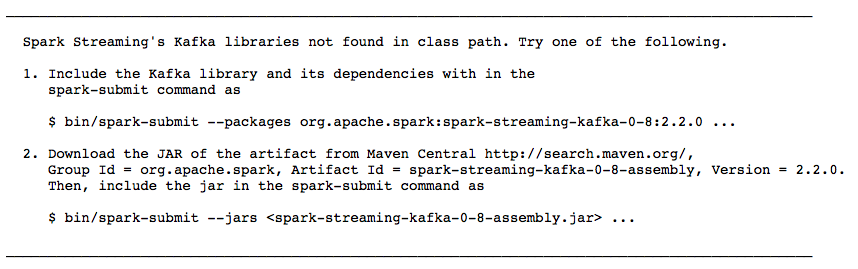

我尝试把jar包直接放到 $SPARK_HOME/lib 目录,在创建SparkContext时就会报另外的错误,求大神指教!

发帖

发帖 与我相关

与我相关 我的任务

我的任务 分享

分享