222

社区成员

发帖

发帖 与我相关

与我相关 我的任务

我的任务 分享

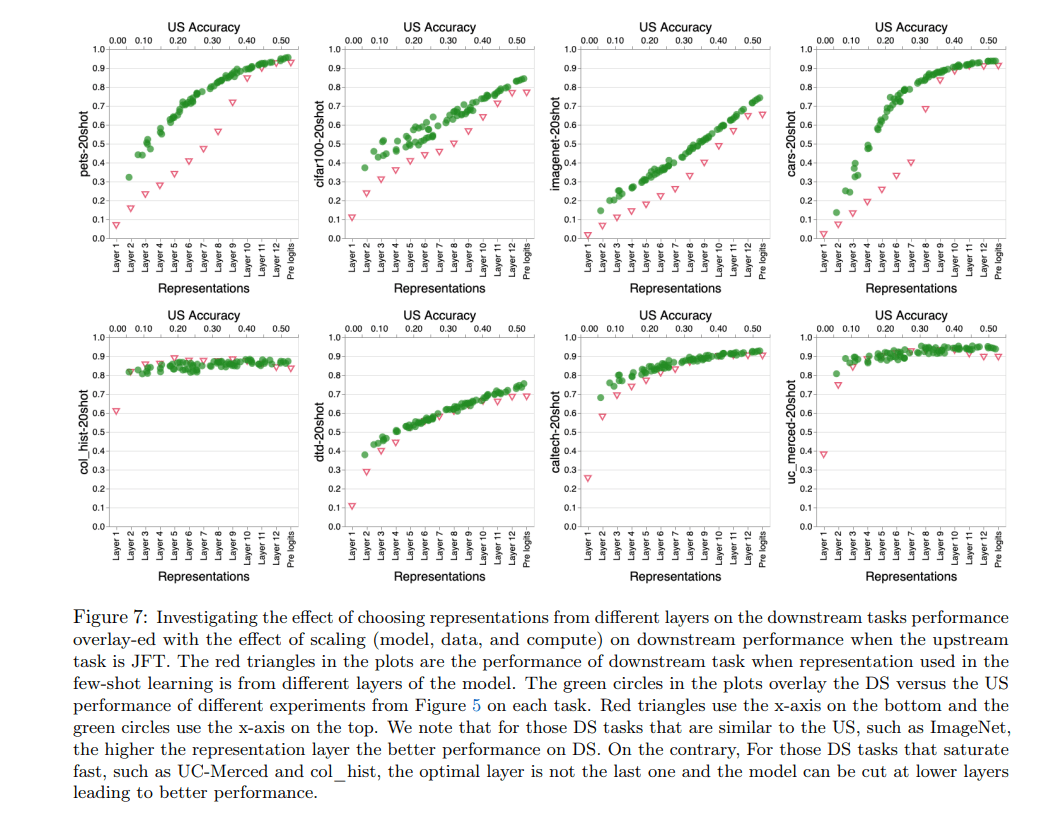

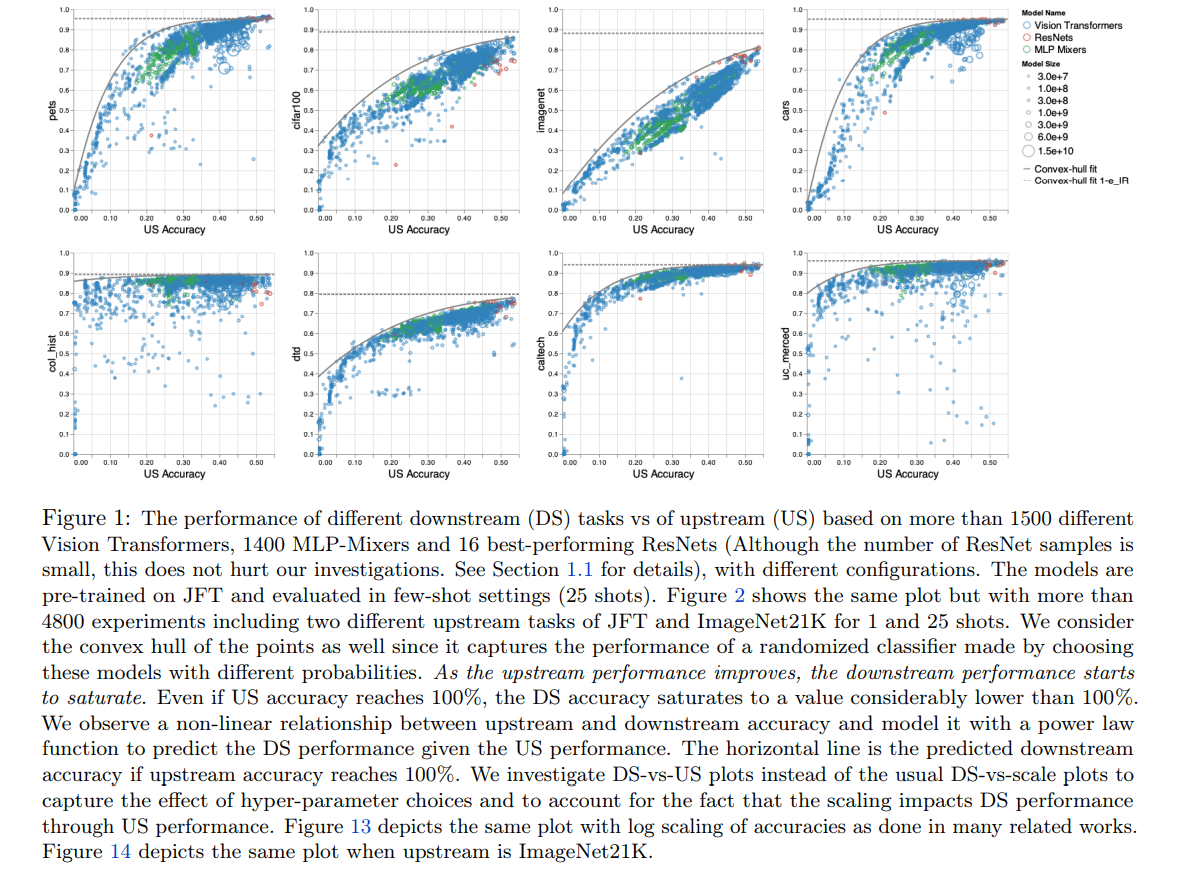

分享#探索大规模模型预训练的局限性# #谷歌# 研究团队对大规模模型预训练的局限性进行了系统探索,包括对参数范围从1000万到100亿的Vision Transformers、#MLP-Mixers# 和#ResNets# 的模型做了4800次实验,在20多个下游图像识别任务上进行评估,旨在找到上游和下游任务之间性能的非线性关系。研究人员指出,缩放(scaling)并不会导致一个模型适合所有的解决方案,没有单一的预训练检查点可以在所有可能的下游任务上表现良好。相对于专注特定的下游任务,研究人员应该做出以提高广泛下游任务的性能的设计选择。论文:https://arxiv.org/abs/2110.02095