1,384

社区成员

发帖

发帖 与我相关

与我相关 我的任务

我的任务 分享

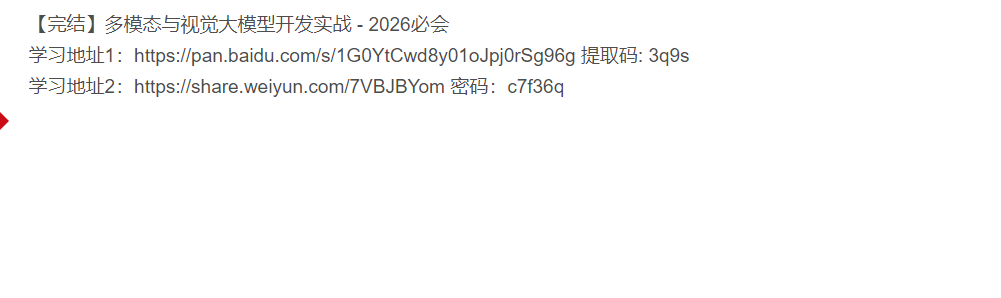

分享【完结】多模态与视觉大模型开发实战 - 2026必会

引言:当AI开始“看见”并“理解”世界

2026年的技术世界,单一模态的AI模型如同只能听到声音却看不见画面的收音机,已经无法满足复杂场景的需求。多模态与视觉大模型正以前所未有的速度,重塑着从医疗诊断到自动驾驶,从智能创作到工业质检的每一个领域。据统计,到2026年,全球多模态AI市场规模预计将突破500亿美元,成为继大语言模型后最具颠覆性的技术浪潮。掌握多模态与视觉大模型开发能力,已经成为技术从业者不可回避的“必会”技能。

一、多模态融合:超越单一感官的智能革命

1.1 从单一到融合的技术演进

多模态AI的核心突破在于其整合处理文本、图像、音频、视频等多种信息的能力。传统的视觉模型如CNN(卷积神经网络)虽然擅长图像识别,却无法理解图像中的语义内容;语言模型如Transformer虽能处理文本,却对视觉信息“视而不见”。多模态模型通过统一的架构,实现了跨模态的理解与生成。

2026年的多模态模型已经进化到第三代:第一代如CLIP(Contrastive Language-Image Pretraining)通过对比学习建立了图像与文本的关联;第二代如DALL-E实现了从文本到图像的生成;第三代模型则实现了多模态信息的深度融合与双向理解,能够处理视频、音频、文本和图像的任意组合,并生成连贯的多模态输出。