1,384

社区成员

发帖

发帖 与我相关

与我相关 我的任务

我的任务 分享

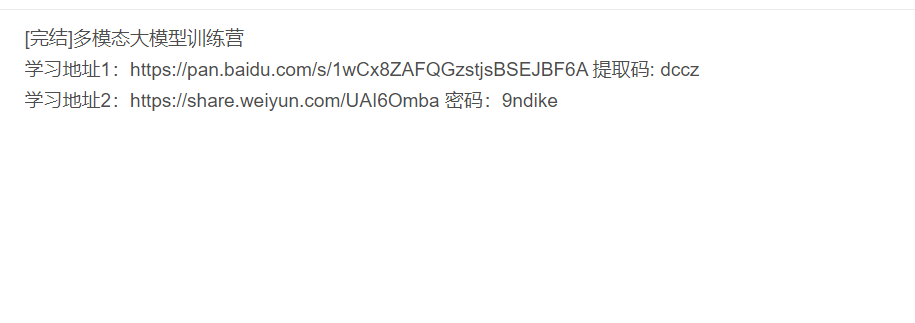

分享[完结]多模态大模型训练营

多模态学习的本质是让机器像人类一样,通过多种感官通道理解世界。人类认知天生是多模态的——我们通过眼睛观察、耳朵聆听、手指触摸,大脑将这些信息整合成对世界的统一理解。同样,多模态AI旨在整合不同数据源的信息,获得比任何单一模态更丰富的理解。

从技术角度,多模态学习的核心挑战在于模态对齐与融合。例如,如何确保AI理解“狗”这个单词时,能将其与狗的图片、狗的叫声以及“忠诚”、“宠物”等相关概念联系起来?这需要解决几个关键问题:

首先,表示学习——如何将不同模态的数据转化为统一的表示空间。文本可能被编码为词向量,图像被编码为特征图,音频被编码为频谱图,这些不同的表示需要在语义层面上对齐。

其次,跨模态关联——建立不同模态之间的语义联系。这通常通过在大量配对数据(如图像-描述对)上进行训练实现,使模型学会不同模态之间的对应关系。

最后,多模态融合——如何有效地整合来自不同模态的信息。早期融合、晚期融合和混合融合等策略各有优劣,取决于具体任务和数据特性。

多模态大模型训练营:理论与实践的熔炉

随着多模态AI的重要性日益凸显,专门针对这一领域的“多模态大模型训练营”应运而生,成为培养新一代AI人才的关键平台。这些训练营通常结合了前沿理论与动手实践,为参与者提供从零到一的完整学习路径。