//kafka发送信息

#kafka Producer配置

value.serializer=org.apache.kafka.common.serialization.ByteArraySerializer

key.serializer=kafka.serializer.StringEncoder

producer.send(new ProducerRecord<String, byte[]>(topic, key, SerializationUtils.serialize(value)));

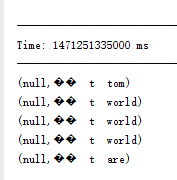

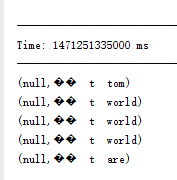

//sparkstreaming消费信息

KafkaUtils.createDirectStream[String, String, StringDecoder, StringDecoder](scc, kafkaParam, topics)

//sparkstreaming端乱码

有没有遇到的,求解!

发帖

发帖 与我相关

与我相关 我的任务

我的任务 分享

分享