7,216

社区成员

发帖

发帖 与我相关

与我相关 我的任务

我的任务 分享

分享随着 ChatGPT等LLM模型,Stable Diffusion,Midjourney等LVM模型火爆,生成式AI大模型浪潮席卷全球。

国际上OpenAI的chatgpt4 , Google的Gemini ,Meta的Llama,国内国内,包括百度、阿里巴巴、百川智能及智谱AI在内的一众大厂和创新公司也在不断发力追赶国外进度。

然而这些LLM/LVM大模型的部署和运行,动辄就是部署在云端大算力的GPU加速卡,普通的开发者有心无力。

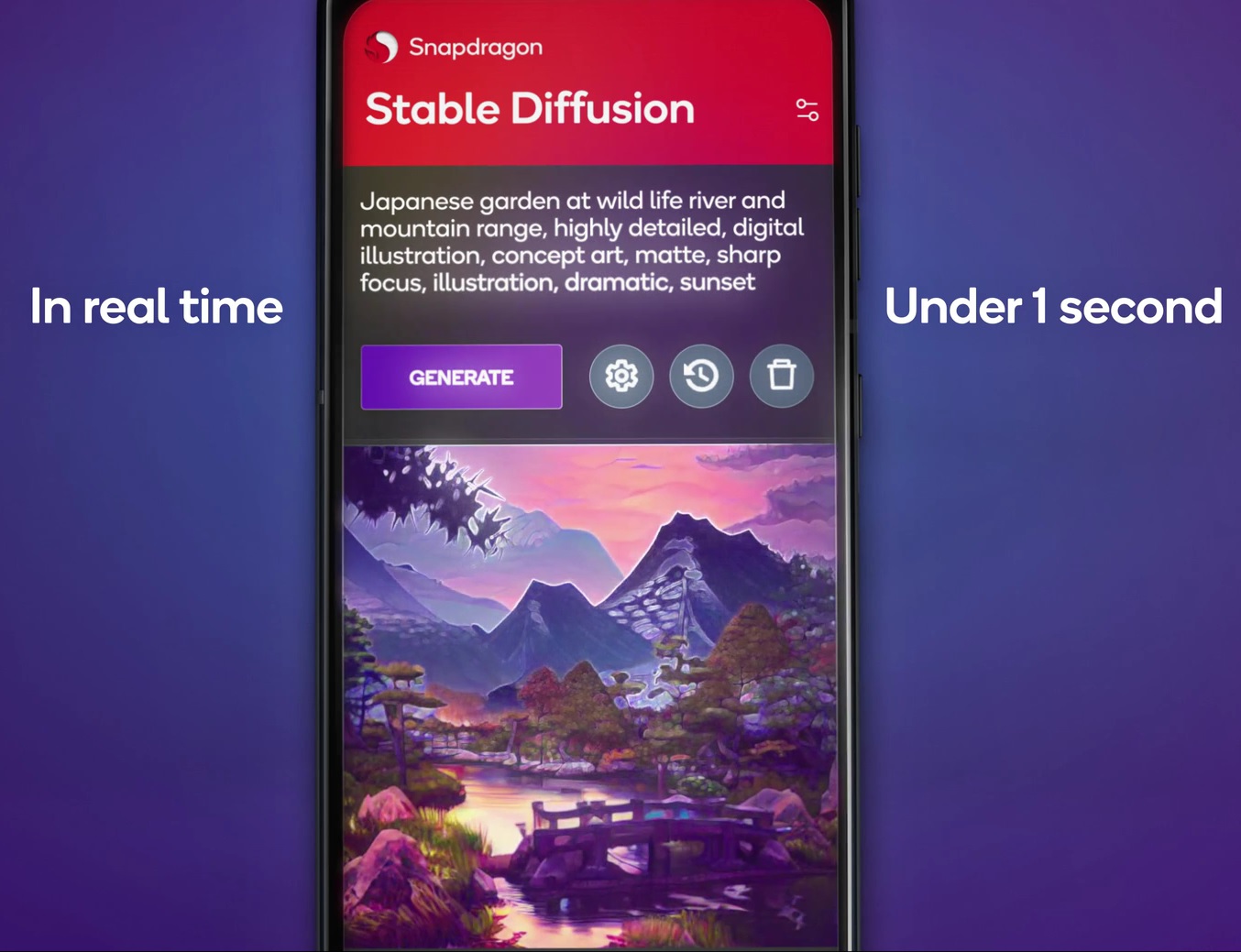

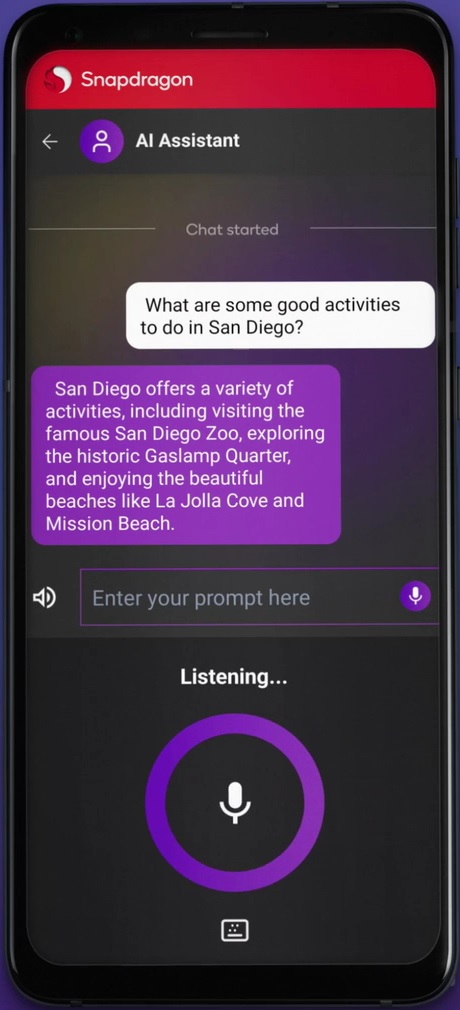

生成式AI与边缘侧、终端侧设备相结合,降低运行成本、加快响应速度,对于生成式AI的商业落地有着重要促进作用。高通的SOCNPU、GPU和CPU,正在力推生成式AI浪潮从云端向边缘与终端侧延伸。

基于高通SOC的Fast Stable Diffusion能够在一秒内生成图像

基于高通SOC的Llama2的AI 助手最快能达到20 tokens/s

具体的内容和demo详见以下链接

Accelerating generative AI at the edge | Knowledge distillation & Quantization | Qualcomm

可以跑开源的CPU版本的LLM-ggml?