4,659

社区成员

发帖

发帖 与我相关

与我相关 我的任务

我的任务 分享

分享在当今的数据驱动时代,存内计算架构(In-Memory Computing, IMC)已成为处理大规模数据集的关键技术。这种架构允许数据直接在内存中处理,相比传统基于磁盘的计算方式,其大幅提高了数据处理的速度和效率。然而,随着数据量的日益增长,即使是最先进的存内计算系统也面临着诸如内存容量限制、能耗管理和数据处理效率等挑战。为了克服这些挑战,算法优化技术如量化、稀疏化、精度调整等显得尤为重要。这些技术通过减少算法对存储和计算资源的需求,不仅提高了存内计算的效率,还拓宽了其应用范围,对于推动存内计算架构的发展和优化现代数据处理流程至关重要。

本篇文章将从量化和精度调整的角度出发,分别介绍各自的概念、工作原理、在存内计算架构上的应用以及存在的利弊。通过深入探讨,我们将了解这些技术在提高存内计算性能方面的重要性,以及它们如何帮助我们应对未来数据处理的挑战。

(一)量化技术的概念

为了保证运算的精度,大多数的科学运算采用的是浮点运算,常见的是32位或64位浮点型数。对于深度学习而言,乘累加计算的规模较大,但端上产品的算力往往是有限的,需要利用新型技术降低计算量,由此量化技术应运而生。

量化,即将高精度浮点数(如32位或64位)表示的网络权值以及激活值用低精度数(如8位或16位)来近似表示,以此减少了每个数据点所需的内存空间,同时也降低了处理这些数据所需的计算资源。在一些应用中,可以通过量化算法适当降低数据精度,而不会显著影响最终结果的质量。

(二)量化技术的工作原理

模型量化技术的本质是函数映射。根据映射函数是否为线性,可以将模型量化分为线性量化和非线性量化[1]。

关于线性量化的工作原理可以解释如下:

假设有一个浮点数f,希望将其量化为一个整数q。线性量化的过程可以表示为:

![]()

其中,S是比例因子(scale factor),用于缩放浮点数值以适应较低的位宽,而Z是零点(zero point),用于表示量化值中的零值。这个过程的逆变换,即从量化的整数值q转换回浮点数值f,可以表示为:

![]()

在这里,round函数用于四舍五入操作,将缩放后的值转换为最接近的整数。比例因子S和零点 Z 的选择取决于浮点数值的范围和所需的整数精度。例如,在8位量化中,整数值范围可能是从 0 到 255(非对称量化)或 -128 到 127(对称量化)。

非线性量化的工作原理与线性量化不同,其通常用于更准确地表示数据中的特定范围,尤其是对于具有非均匀分布的数据。非线性量化过程可以用以下形式的公式表示:

![]()

其中,f 是原始的浮点数值,N(f) 是一个非线性函数,它将f 转换为一个更适合量化的格式。转换后的值再通过一个量化函数q进行线性量化。非线性函数N的选择取决于数据的特点和所需的量化精度。例如,对于图像数据,常用的非线性量化函数包括对数或sigmoid函数,这些函数可以更有效地表示图像中的亮度变化。

逆变换,即从量化的整数值q转换回浮点数值f,则需要先进行逆量化,然后应用非线性函数的逆函数。这个过程可以表示为:

![]()

(三)量化技术在存内计算架构中的应用

IBM研究人员开发了一种基于阻变随机存取存储器(ReRAM)的存内计算系统,用于执行深度神经网络的前向传播。在这个系统中,神经网络的权重被量化并存储在ReRAM单元中。这些量化后的权重可以直接在ReRAM阵列内进行矩阵-向量乘法运算,这是神经网络计算中最常见和最密集的操作之一。通过量化,这个系统能够在不牺牲太多精度的情况下,显著减少每个权重所需的存储空间。这样,更大的神经网络模型可以存储在相同大小的ReRAM阵列中,同时还减少了数据在处理单元和存储单元之间的传输需求,从而降低了能耗并提高了计算速度。

在这种架构中,量化技术不仅改进了数据存储的密度和效率,而且由于直接在存储介质内部进行计算,还大大加快了数据处理速度,尤其是在执行大规模并行运算时。这种结合了量化和存内计算技术的系统在处理深度学习任务时表现出了优异的性能。

综上所述,量化技术在提高存内计算架构的存储效率、计算速度等方面发挥着至关重要的作用,同时也为高精度的数据处理提供了支持。随着技术的不断发展,量化在存内计算领域的应用和影响将会进一步扩大。

(四)量化技术面临的挑战

量化技术减少了模型的存储大小,并加快了数据处理的速度。然而,实现有效量化的过程也伴随着挑战,尤其是如何在降低数据精度的同时保持模型的性能和准确度。量化可能导致信息损失,从而影响模型性能。特别是在对精度要求高的领域,如医疗影像,这种影响尤为显著。此外,量化过程可能引入额外的计算复杂性,如校准和量化感知训练。这些步骤虽有助于减少量化误差,但也可能增加计算负担。同时,量化技术的应用还需要考虑硬件兼容性,因为不是所有硬件平台都能高效处理量化后的数据。

总之,量化技术在推动计算和存储效率方面具有重要价值,但同时需要克服准确度损失、计算复杂性增加和硬件兼容性等挑战。

(一)精度调整的概念及其在计算中的影响

在算法和模型的领域中,精度调整通常指的是对计算中所用数据的表示精度进行有意的调整。这种调整是为了在计算资源(如处理时间和存储空间)与结果的准确性之间找到一个最佳平衡点。特别是在存内计算架构中,这种平衡变得尤为重要。

在存内计算架构中,精度调整对计算效率的影响是显著的。通过减少每个数据元素所需的位数,可以在相同的物理空间内存储更多的数据,从而减少了对存储空间的需求。此外,降低精度意味着计算操作可以更快完成,因为处理的数据量减少了。例如,在某些机器学习应用中,使用低精度的浮点表示可以加快训练和推理过程,同时对最终结果的准确性影响不大。

精度的调整还直接影响着能源消耗。在存内计算架构中,能耗主要来自于数据处理和数据移动。通过减少所需处理的数据量,精度调整能有效降低能耗。这在处理大规模数据集,尤其是在数据中心和云计算环境中非常重要。

在存内计算系统的设计中,精度调整是一种至关重要的技术,它解决了这样一个核心问题:如何在提高计算效率和降低功耗的同时,保持或增强系统输出的准确性。随着技术的进步,现代存内计算系统(IMC-SoC)面临着更高的性能要求,特别是在能耗和处理速度方面。然而,这些系统往往受限于物理噪声,如热噪声、电信号干扰等,这些都可能导致数据损失和计算误差。

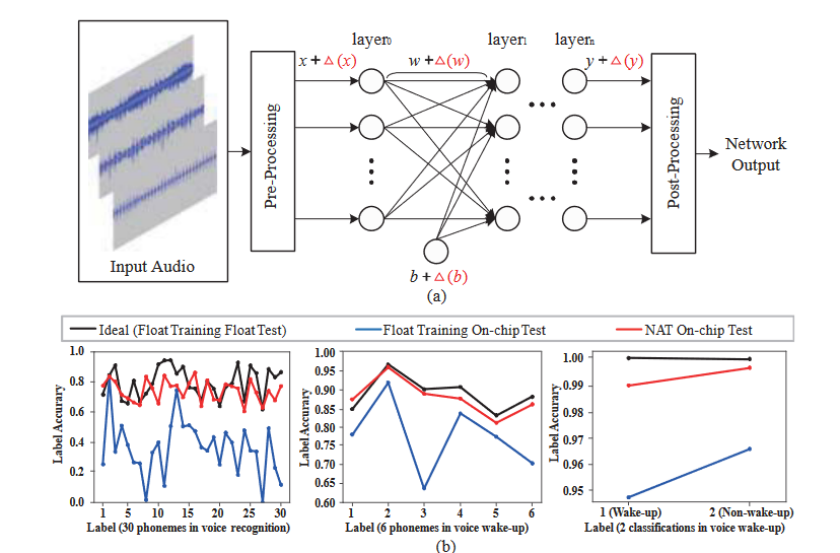

模拟噪声训练(Analog Noise Training, NAT)[2] 作为一种创新的方法,特别强调了通过在硬件层面上模拟和训练来适应系统噪声,有助于减少数字后处理阶段的错误。例如,补偿技术通过对IMC模型的噪声响应进行建模,能够在不牺牲输出数据质量的情况下提高性能。这种精度调整和补偿策略在声音识别和唤醒应用中得到了测试,并显示了显著的性能提升。具体来说,经过噪声抑制和补偿技术处理后,系统的语音识别准确率和唤醒应用的性能有了明显改善。这表明通过精度调整,即使在噪声存在的情况下,也能保持或甚至提高计算精确度。

实验结果显示,应用了噪声抑制和补偿技术的系统在保持较高运算速度的同时,其语音识别和唤醒准确率分别提高了13.5%和3.2%。即便在存在物理噪声的情况下,通过精度调整,系统依然能够平衡计算速度和结果精确度。

图1 (a) 基于IMC-SoC模型的NAT正向传播。(b) 有无NAT的3种网络基准的标签精度。

(三)精度调整的优势和缺陷分析

精度调整作为一种优化计算资源使用的技术,在许多高性能计算应用中发挥着重要作用。它通过降低数据表示的位数或简化计算过程来提升计算效率,这在处理能力和存储资源有限的环境中尤为重要。例如,在存内计算架构中,通过精度调整可以实现更快的数据处理速度,因为它减少了处理单元需要处理的数据量。此外,较低的数据精度可以减少能源消耗,对于需要长时间运行的设备或系统尤为关键。

然而,精度调整并非没有代价。在那些对结果精确度有严格要求的领域,过度降低精度可能会带来严重的后果。在金融建模中,精度的任何损失都可能导致经济损失;而在医疗影像分析中,低精度可能会误诊,对患者健康造成直接威胁。因此,必须仔细权衡精度调整带来的性能提升和潜在风险,特别是在安全或生命健康至关重要的应用中。在实际操作中,通过持续的测试和评估,不断调整策略以找到最佳的平衡点是保证成功的关键。通过这种动态调整和优化,精度调整能够在多变的计算需求和挑战面前展现其真正的价值。

总结与展望

量化和精度调整作为两种关键算法优化技术,在存内计算架构中有着重要作用。通过这些技术,可以显著提高存内计算的效率,尤其是在资源受限的环境中。量化允许在有限的存储和计算资源下运行复杂模型,而精度调整则进一步优化了性能与准确性之间的平衡。

展望未来,随着数据量的持续增长和计算需求的不断提高,这些算法优化技术将变得更加重要。量化和精度调整等技术有望在更广泛的应用领域得到应用,如物联网(IoT)设备、自动驾驶汽车和远程医疗等。

此外,随着人工智能和机器学习技术的进步,我们预计会出现更多创新的算法优化方法,这些方法将进一步提高存内计算的性能和效率。例如,借助自动化机器学习(AutoML)技术,未来可能会开发出能够自动调整量化和精度水平的算法,以适应不同的应用场景和硬件环境。

资料来源

学习了

支持存内计算开发者社区建设!

支持存内计算开发者社区建设!

支持存内计算开发社区的建设

支持存内计算开发社区的建设