4,675

社区成员

发帖

发帖 与我相关

与我相关 我的任务

我的任务 分享

分享去年11月,最强开源代码模型 DeepSeek-Coder 亮相,大力推动开源代码模型发展。

今年5月,最强开源 MoE 模型 DeepSeek-V2 发布,悄然引领模型结构创新潮流。

今天,全球首个在代码、数学能力上与GPT-4-Turbo争锋的模型,DeepSeek-Coder-V2,正式上线和开源。

DeepSeek-Coder-V2 沿用 DeepSeek-V2 的模型结构,总参数 236B,激活 21B,在代码、数学的多个榜单上位居全球第二,介于最强闭源模型 GPT-4o 和 GPT-4-Turbo 之间。

新模型在Aider代码编辑基准测试上的正确率为73%,位居第二,与第一名Claude-3.5-Sonnect仅差4个百分点,但成本却低了20-50倍!最新发布的Llama-3.1-405B-Instruct得分只有66%,比DeepSeek Coder低了7个百分点!

77% claude-3.5-sonnet

73% DeepSeek Coder V2 0724

66% llama-3.1-405b-instruct

60% Mistral Large 2 (2407)

59% llama-3.1-70b-instruct

58% gpt-3.5-turbo-0301

38% llama-3.1-8b-instruct

Aider的代码编辑基准测试要求LLM编辑Python源文件,以完成来自Exercism的133个小编码练习。这个基准测试不仅衡量 LLM 的编码能力,还衡量它是否能够一致地按照系统提示中指定的格式编辑代码。

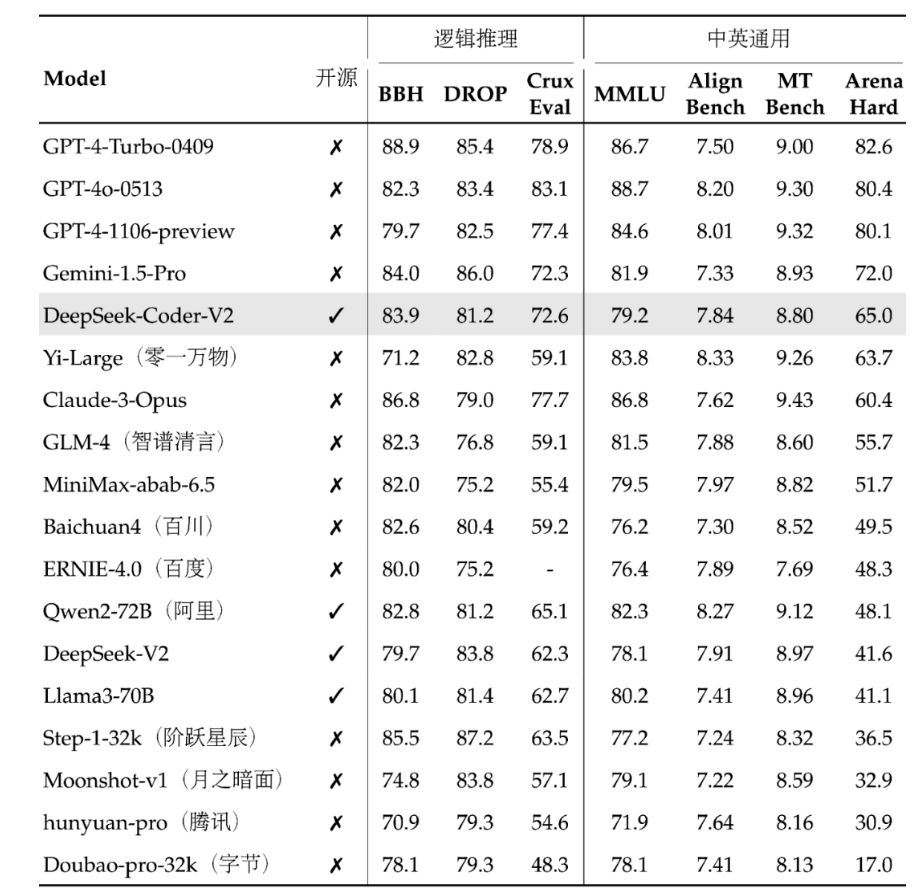

国内第一梯队的通用能力

在拥有世界前列的代码、数学能力的同时,DeepSeek-Coder-V2 还具有良好的通用性能,在中英通用能力上位列国内第一梯队。

虽然 DeepSeek-Coder-V2 在评测中综合得分更高,但在实际应用中,两个模型各有所长。DeepSeek-V2 是文科生,DeepSeek-Coder-V2 是理科生,精通的技能点不同:

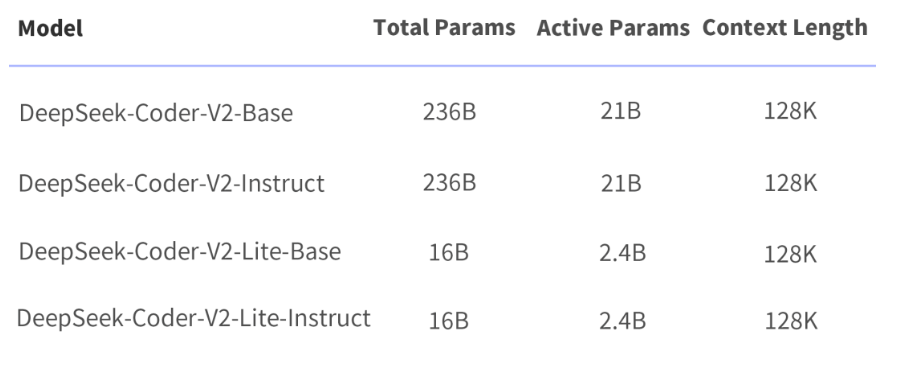

全面开源,两种规模

一如既往,DeepSeek-Coder-V2 模型、代码、论文均开源,免费商用,无需申请。

模型下载:

https://huggingface.co/deepseek-ai

代码仓库:

https://github.com/deepseek-ai/DeepSeek-Coder-V2

技术报告:

https://github.com/deepseek-ai/DeepSeek-Coder-V2/blob/main/paper.pdf

开源模型包含236B和16B两种参数规模

DeepSeek-Coder-V2:总参 236B(即官网和 API 版模型),单机 8*80G 可部署,单机 8*80G 可微调(需要技巧)

DeepSeek-Coder-V2-Lite:总参 16B,激活 2.4B,支持 FIM,代码能力接近 DeepSeek-Coder-33B(V1),单卡 40G 可部署,单机 8*80G 可训练。

API服务

DeepSeek-Coder-V2 API 支持 32K 上下文,价格和 DeepSeek-V2 一致,还是大家熟悉的低价:

本地私有化部署

DeepSeek 提供本地私有化部署服务,标准化成品交付,开箱即用,轻松升级。

价格 45 万/套/年,支持灵活的商务方案(登录官网,联系客服)。

价格包含:

一台推理训练一体化的高性能服务器(Nvidia H20、Huawei 910B 或其它同级别显卡,8 显卡互联)。

模型:DeepSeek-V2-236B、Coder-V2-236B、后续其它模型。

一站式软件套件:推理、微调、运维等。

对每个客户,DeepSeek 均会针对应用场景,使用公开数据、脱敏数据进行训练和调优。客户可以使用私有数据进一步微调。

不低于 5 人日/年的技术支持。

预期性能:

输入:20000 tokens/s

输出:5000~10000 tokens/s

官网已上线 DeepSeek-Coder-V2

访问对话官网:coder.deepseek.com,与 DeepSeek-Coder-V2 永久免费畅聊。

访问开放平台:platform.deepseek.com,使用最新 DeepSeek-Coder-V2 API。