57,902

社区成员

发帖

发帖 与我相关

与我相关 我的任务

我的任务 分享

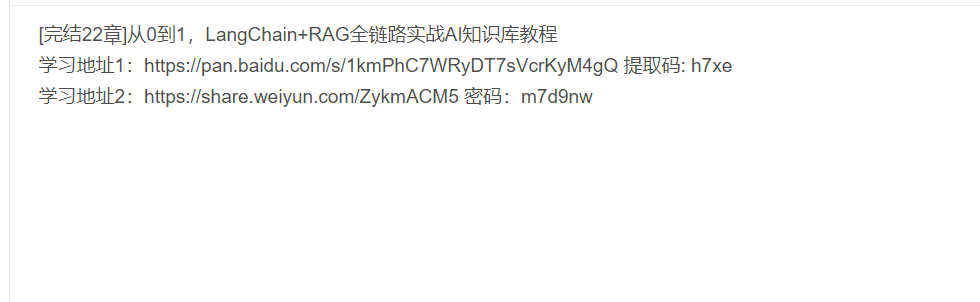

分享[完结22章]从0到1,LangChain+RAG全链路实战AI知识库教程

在信息爆炸的时代,每个企业都坐拥大量文档、报告、手册等非结构化数据,却常常陷入“知识就在那里,但就是找不到”的困境。传统的关键词搜索如同在迷雾中摸索,而早期基于规则的聊天机器人则显得僵硬笨拙。直到检索增强生成(RAG)技术的出现,配合LangChain这一强大框架,我们终于能够构建真正理解内容、给出精准回答的AI知识库。本文将带您踏上一场从零开始的实战之旅,完整揭示如何利用LangChain+RAG技术栈,让沉默的数据开口说话。

RAG+LangChain:AI知识库的黄金搭档

RAG(Retrieval-Augmented Generation)的核心思想极为巧妙——它将传统的信息检索与现代的大语言模型生成能力相结合。当用户提出问题时,系统首先从知识库中检索相关文档片段,然后将这些片段与原始问题一起喂给大语言模型,最终生成基于事实的、来源可追溯的答案。这种方法既弥补了大模型内部知识可能过时或不准确的缺陷,又避免了传统搜索仅返回片段而缺乏综合回答的不足。

而LangChain,作为当前最流行的LLM应用开发框架,恰恰为RAG的实现提供了全链路工具。从文档加载、文本分割、向量嵌入,到检索器构建、提示工程和对话链设计,LangChain如同一条流水线,将各个组件有机串联。它支持多种文件格式(PDF、Word、Markdown等),兼容主流向量数据库(Chroma、Pinecone等),并提供灵活的链式调用机制,让开发者能专注于业务逻辑而非底层实现。