109

社区成员

发帖

发帖 与我相关

与我相关 我的任务

我的任务 分享

分享近年来,大语言模型(LLMs)如 GPT、LLaMA 等展现了强大的知识存储与推理能力,但它们也常出现“幻觉”——输出错误或过时的信息。传统方法如全量微调虽然能修正知识,但耗时耗力且容易导致模型遗忘已有能力。因此,知识编辑 成为研究热点,目标是精准修改模型中的特定知识,同时保持其原有能力。

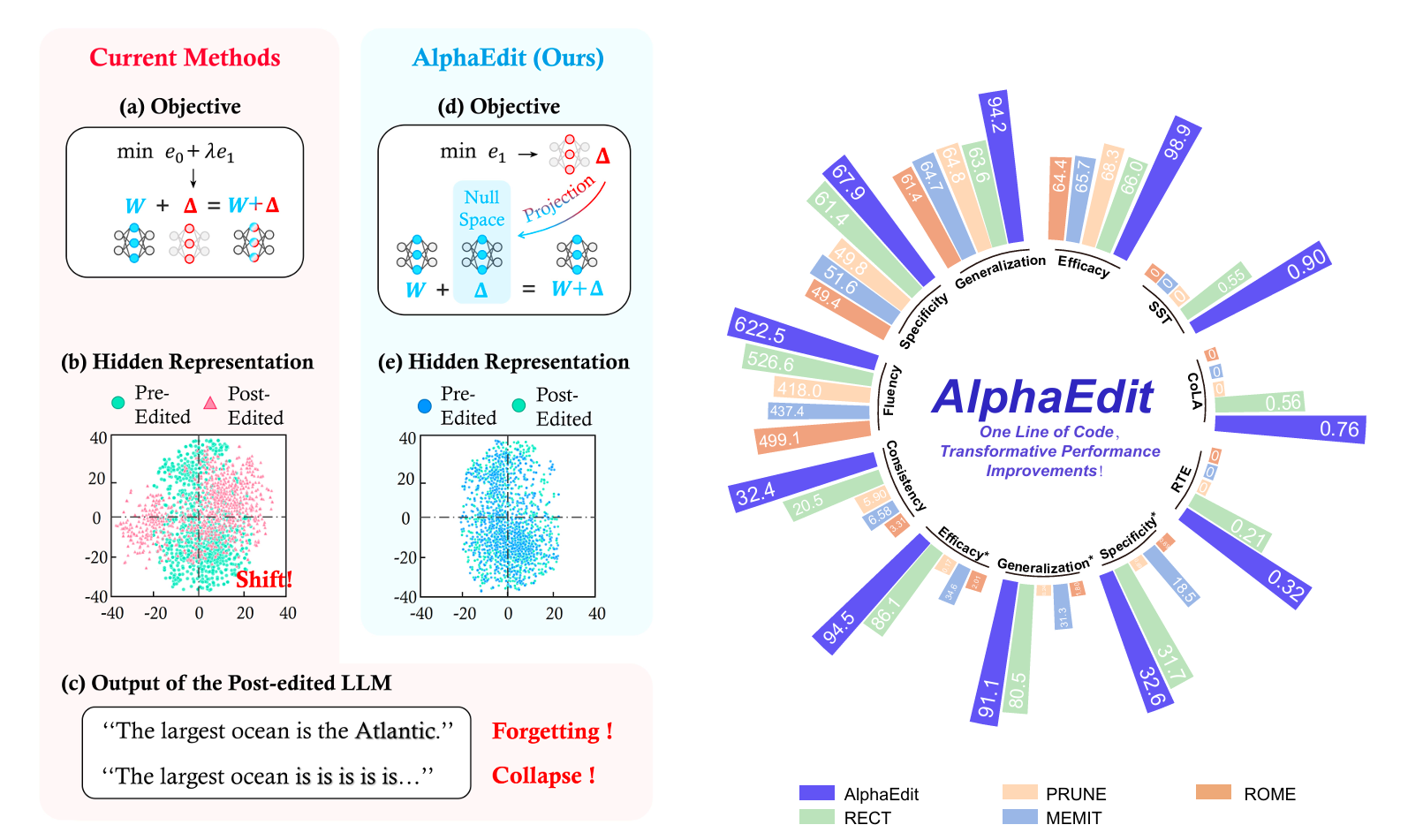

然而,当前主流的知识编辑方法(如“定位-编辑”范式)面临一个根本难题:在更新目标知识与保留原有知识之间难以平衡。过度强调更新会导致模型过度拟合新知识,进而破坏原有知识结构,甚至在多次连续编辑后引发“模型崩溃”。

来自中科大与新加坡国立大学的研究团队提出了 AlphaEdit,一种简单而强大的知识编辑方法。其核心思想来源于数学中的零空间(Null Space)概念。

去掉平衡项,专注更新

传统方法在目标函数中同时优化“更新误差”和“保护误差”,往往顾此失彼。AlphaEdit 直接移除对旧知识的保护项,让模型全力优化新知识的更新。

投影到零空间,保护旧知识

通过将参数更新投影到旧知识矩阵的零空间中,确保这次更新不会影响已有知识的表达。数学上,这等价于让更新方向与旧知识正交,从而实现“无干扰编辑”。

AlphaEdit 通过零空间投影,确保了编辑更新不会改变模型对旧知识的内部表示分布。实验中的隐藏状态可视化显示,使用 AlphaEdit 编辑后的模型,其表示分布与编辑前几乎完全一致,而基线方法则出现明显偏移。这说明 AlphaEdit 真正实现了精准定向更新,而非全局扰动。

AlphaEdit 不仅为知识编辑提供了一种高效、稳定的新工具,其核心思想——通过投影约束实现目标解耦——也可推广至其他模型修正场景,例如安全对齐、多任务学习、领域适应等。论文作者也指出,未来可探索将其应用于多模态大模型与推理模型的编辑中。

知识编辑是大语言模型持续学习与可控演化的重要方向。AlphaEdit 以一行代码的极简改动,实现了对知识更新与保护的根本性平衡,为后续研究与实际应用提供了有力工具。

论文标题:AlphaEdit: Null-Space Constrained Knowledge Editing for Language Models

作者:Junfeng Fang, Houcheng Jiang, Kun Wang, Yunshan Ma, Jie Shi, Xiang Wang, Xiangnan He, Tat-Seng Chua

发表:ICLR 2025

代码已开源:https://github.com/jianghoucheng/AlphaEdit