92

社区成员

发帖

发帖 与我相关

与我相关 我的任务

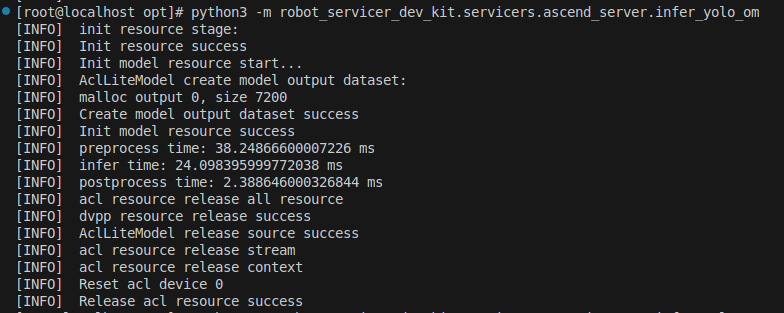

我的任务您好,我们现在已经结合了OE中/opt/robot_servicer_dev_kit/servicers/ascend_server/main.py中和Yolo_Grasp_Net的教程,能够进行基本的基于ACL Lite的YOLO推理,结果如下图所示:

我们在实际中使用的是一些开放词汇系列的模型: YOLOE, YOLO-World:

更具体地,我们使用的是yoloe-v8l-seg.pt, yolov8l-world.pt,这些模型在初始化的时候能够读取一个开放词汇列表,并且能够根据开放词汇列表动态地确定自己的识别类别,想要问一下您是否有过将相关的开放词汇系列的YOLO部署在昇腾上的经验和教程,能否烦请您给予我们相关的支持,谢谢您

我们前文提到的使用的YOLO模型,能够输出直接的物体的mask,映射到图片上如下图所示:

想要问一下,您是否有将sam模型部署在昇腾上的经验和教程,能否烦请您给予我们相关的支持,谢谢您

想要问一下,我们目前使用的是apple的mobileclip,您是否有将mobileclip模型部署在昇腾上的经验和教程,能否烦请您给予我们相关的支持,谢谢您

感谢分享

开发者您好,

1、yoloe-v8l-seg.pt, yolov8l-world.pt这两个模型应该都没有官方适配过,需要的话可以使用在线推理,如果在线推理的耗时无法接受的话,可以尝试使用pt转onnx转OM后在昇腾上跑。

pt转onnx转OM:参考https://gitcode.com/Ascend/ModelZoo-PyTorch/blob/master/ACL_PyTorch/built-in/cv/YoloF_for_Pytorch/readme.md

2、是否有将具有-seg的掩码输出能力:这部分为模型的后处理流程,后处理这部分没有提供这部分封装好的能力,需要自己实现。

3、是否有将sam模型部署在昇腾上的经验和教程、是否有将mobileclip模型部署在昇腾上的经验和教程:官方适配过的可以查看Asced modelzoo:

①https://gitcode.com/Ascend/ModelZoo-PyTorch

②https://gitcode.com/Ascend/modelzoo

③https://gitcode.com/Ascend/modelzoo-GPL

以上如果没有的话可以尝试使用1中提到的pt转onnx转OM后在昇腾上跑

92

社区成员

发帖

发帖 与我相关

与我相关 我的任务

我的任务加载中

「智能机器人开发者大赛」官方平台,致力于为开发者和参赛选手提供赛事技术指导、行业标准解读及团队实战案例解析;聚焦智能机器人开发全栈技术闭环,助力开发者攻克技术瓶颈,促进软硬件集成、场景应用及商业化落地

试试用AI创作助手写篇文章吧