92

社区成员

发帖

发帖 与我相关

与我相关 我的任务

我的任务【桌面整理赛题】graspnet点云空间对齐错误导致目标抓取姿态失真问题及解决方案

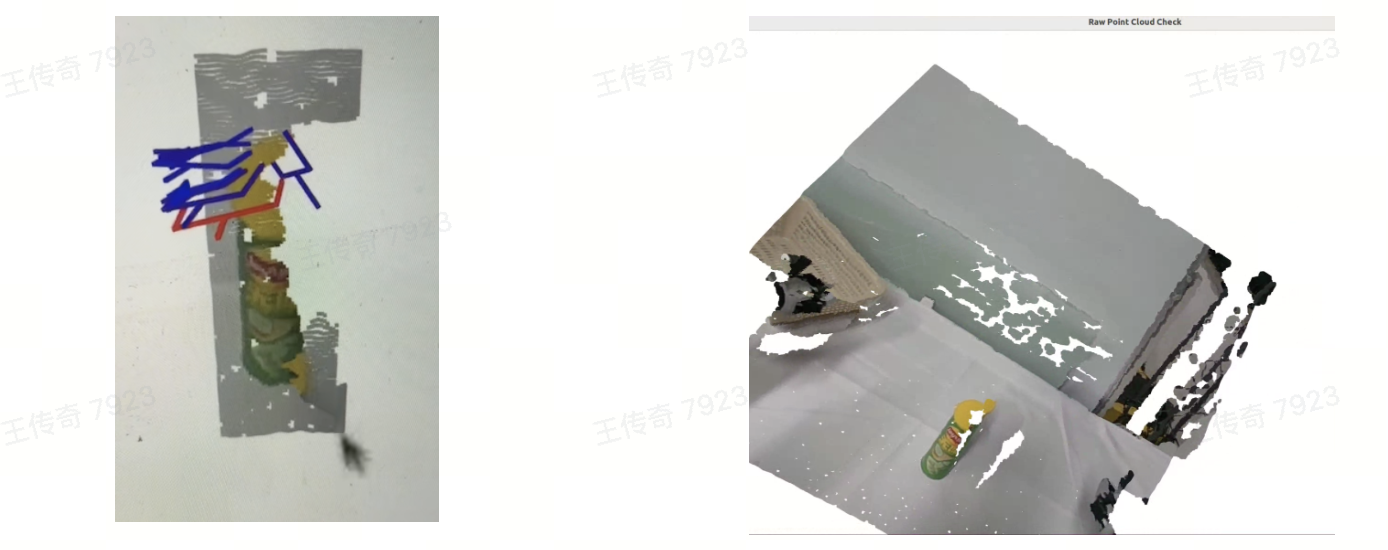

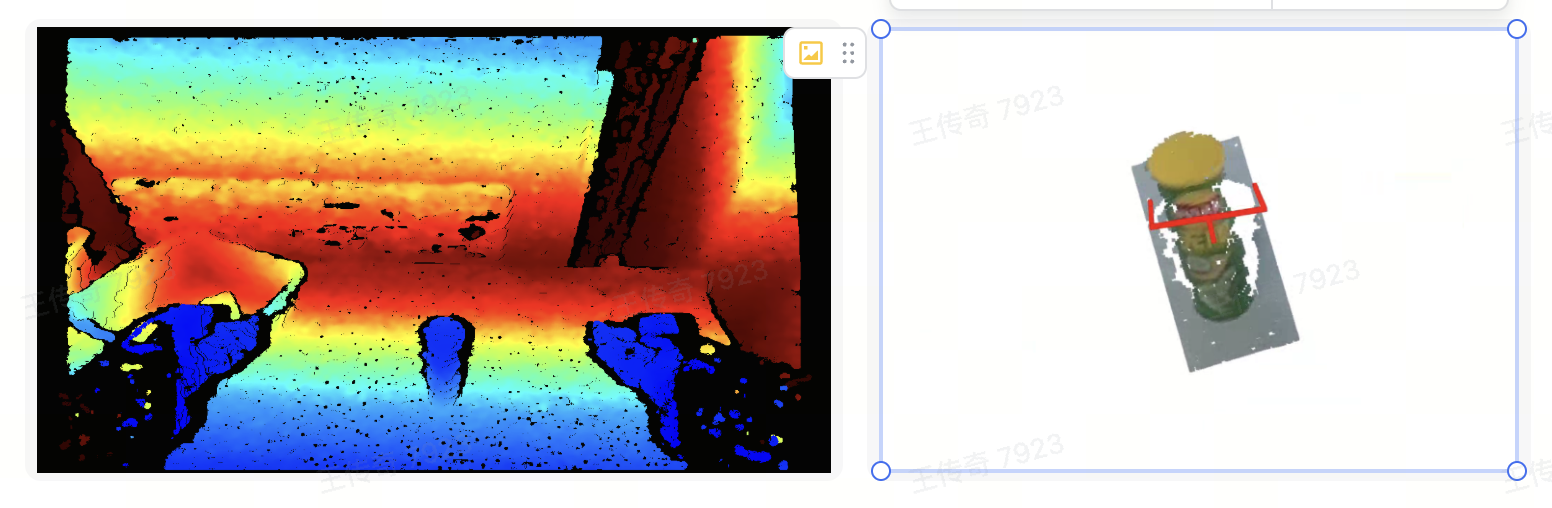

1. 在尝试具身智能典型算法——分层模型(即yolo11+graspnet)过程中,遇到了生成抓取姿态不匹配且几乎完全失效的问题。如下图所示,可以看到模型输出的姿态有很严重的偏移,且抓取点置信度不够。

2. 通过上面两幅点云图可以很明显地看出深度丢失或深度信息未对齐的情况。

3. 因此,分析原RGB图像以及3通道可视化辅助的深度图像,发现:

物理偏移(Baseline):这两个传感器在相机模组上的物理位置存在水平间距(基线)。

坐标系不统一:默认情况下,深度图处于红外相机坐标系下,而 RGB 图处于彩色相机坐标系下。由于视野(FOV)和光轴位置的不同,直接叠加会导致像素点无法重合,通常表现为物体边缘出现几十像素的偏移或“重影”。

4. 解决方案:

核心逻辑:利用相机的外参(传感器间的相对位置矩阵)和内参,将深度图中的每个像素点重投影到彩色相机的坐标系中。

SDK 实现:在采集程序中使用 RealSense SDK 提供的 rs.align 模块。

通过 rs.align(rs.stream.color) 定义对齐目标。

调用 align.process(frames) 对原始帧进行实时重映射,生成一张尺寸、视野与 RGB 图完全一致的对齐深度图。

5. 结果展示:可以看到通过对齐深度图,将深度信息进行统一对齐,即可在3d点云空间下正确反映物体的位置,从而获得graspnet输出的抓取目标姿态

感谢分享

牛的

好奇yolo11+graspnet最终效果如何?

感谢分享!

感谢分享!

92

社区成员

发帖

发帖 与我相关

与我相关 我的任务

我的任务加载中

「智能机器人开发者大赛」官方平台,致力于为开发者和参赛选手提供赛事技术指导、行业标准解读及团队实战案例解析;聚焦智能机器人开发全栈技术闭环,助力开发者攻克技术瓶颈,促进软硬件集成、场景应用及商业化落地

试试用AI创作助手写篇文章吧