7,639

社区成员

发帖

发帖 与我相关

与我相关 我的任务

我的任务 分享

分享官网教程与ort_setup.ps1脚本都让人有点混乱:

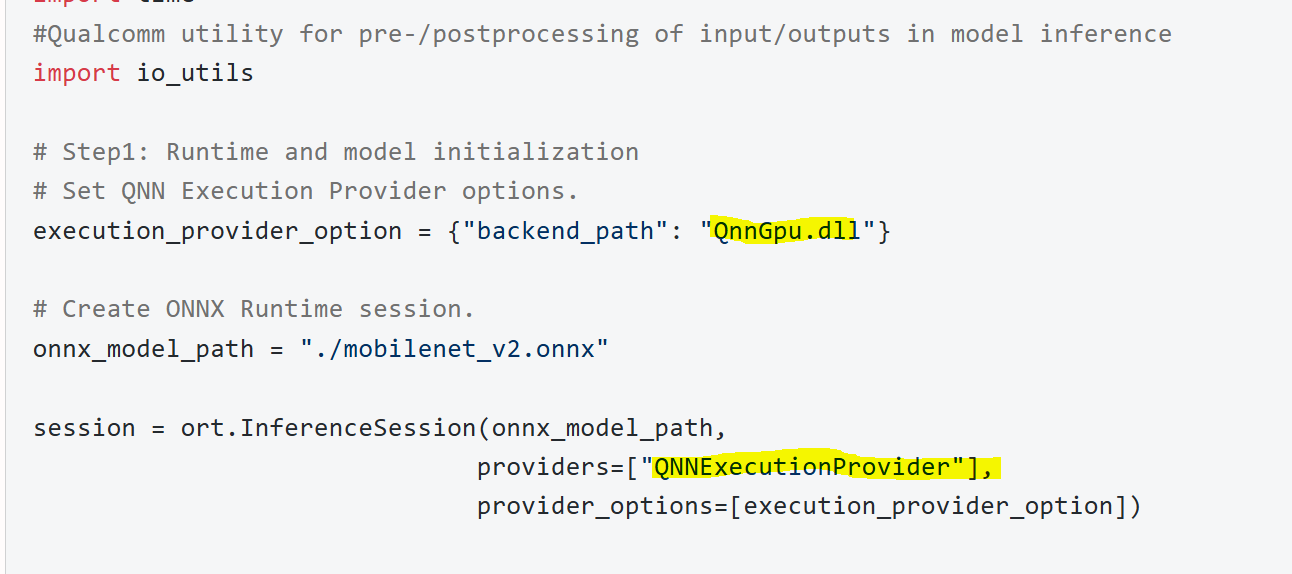

首先是官网的:

为什么GPU的backend使用了QNNExecutionProvider呢?

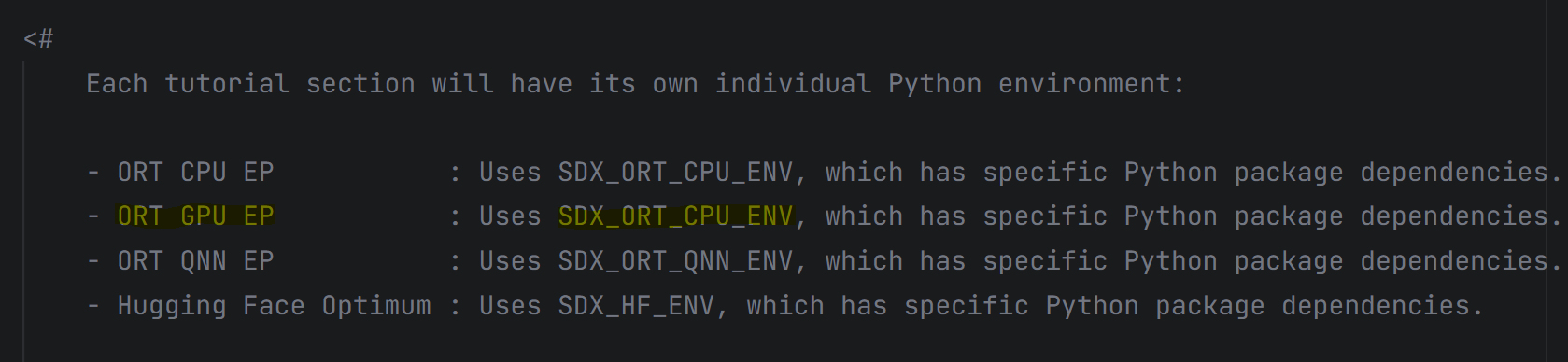

其次:

按照setup脚本为什么GPU EP使用和CPU EP一样的环境,这样我安装了onnxruntime 1.22.0,填写GPUExecutionProvider就会报错。

按照脚本中所说的onnxruntime版本尝试了所有环境情况也都报错。

对于你所说的官网和ort_setup.ps1来源是在哪里,请注明链接